【雛形あり】社内AIポリシー策定ガイド|策定8ステップと条文例、運用を成功させる秘訣

生成AIの登場により、多くのホワイトカラー業務が劇的に効率化される可能性が現実のものとなりました。文章作成、情報収集、データ分析、プログラミング支援など、その応用範囲は日々広がっています。しかし、その一方で、入力した機密情報が外部に漏洩するリスク、AIが生成した誤情報(ハルシネーション)による意思決定の誤り、著作権や個人情報保護といった法的な課題など、無視できない重大なリスクも存在します。

実際、海外の大手メーカーでは、従業員が機密情報を含むソースコードを安易にAIに入力した結果、情報が外部に流出してしまった事例も報告されています。このような事態を避け、AIの恩恵を最大限に引き出すためには、全社統一の明確なルール、すなわち「社内AIポリシー」の策定が不可欠です。

「何から手をつければいいかわからない」「禁止事項だらけで、かえって業務が非効率になるのではないか」「策定しても形骸化してしまうのでは」

この記事は、そんな悩みを抱える経営層、情報システム、法務、人事の担当者様に向けて書かれています。今日から使える社内AIポリシーの雛形(テンプレート)はもちろん、策定から運用、そして改善までの具体的な手順、業界別のカスタマイズ例、そして現場に定着させるための仕組みづくりまで、必要な情報を一気通貫で解説します。

公的機関(総務省、JDLAなど)のガイドラインも参考にしつつ、自社の状況に合わせて実践的なルールを構築するための判断基準を網羅しました。この記事を最後まで読めば、あなたの会社で安全かつ効果的なAI活用を実現するための、具体的で実行可能なロードマップが手に入ることをお約束します。

この記事の要点(60秒で把握)

- 目的の明確化が第一歩: ポリシー策定の目的は「禁止」ではなく「安全な活用の促進」。何を守り、何を推進するのかを最初に言語化することが成功の鍵です。

- 必須7項目の網羅: 「入力禁止情報」「利用可能ツール」「出力の確認責任」「記録」「申請フロー」「違反時の措置」「相談窓口」は、どのようなポリシーにも必須の要素です。

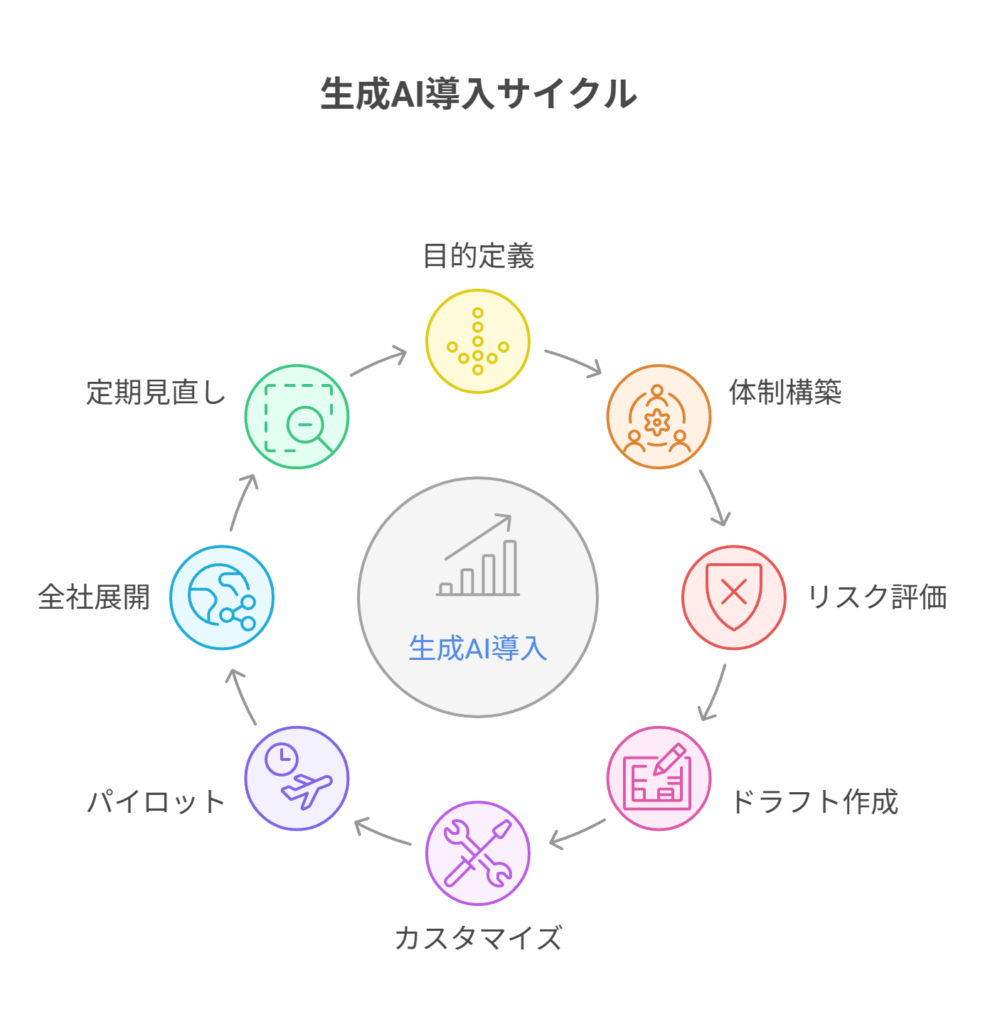

- 策定は8ステップで進める: 「目的定義 → 体制構築 → リスク評価 → ドラフト作成 → カスタマイズ → パイロット運用 → 全社展開 → 定期見直し」の順で進めることで、手戻りなく効率的に策定できます。

- 現場の巻き込みが定着の鍵: ルールを作るだけでなく、現場の代表者を策定プロセスに参加させ、成功事例を共有する場を設けることで、「使われる」ポリシーになります。

- 公的雛形を賢く活用: 総務省やJDLAの雛形を土台に、自社の業界特有の情報(例:金融の顧客データ、製造の設計図)に関する条項を追加することで、効率的かつ網羅的なポリシーが作成できます。

- 生産性向上というゴール: 海外の研究では、AI活用によりタスク完了速度が平均12.2%向上したとの報告もあります。安全な活用ルールは、この生産性向上ポテンシャルを最大限引き出すための土台となります。

- ポリシーは生き物: 一度作って終わりではなく、教育、フィードバック、定期的な見直しのサイクルを運用に組み込み、技術や法規制の変化に対応し続けることが不可欠です。

そもそも社内AIポリシーとは? なぜ今、経営課題なのか

まずは基本に立ち返り、社内AIポリシーの定義、そしてなぜそれが現代の企業経営において急務となっているのかを整理しましょう。

社内AIポリシーの定義と目的

社内AIポリシーとは、生成AIをはじめとするAIツールの業務利用に関する、基本方針と具体的なルールを定めた社内文書です。

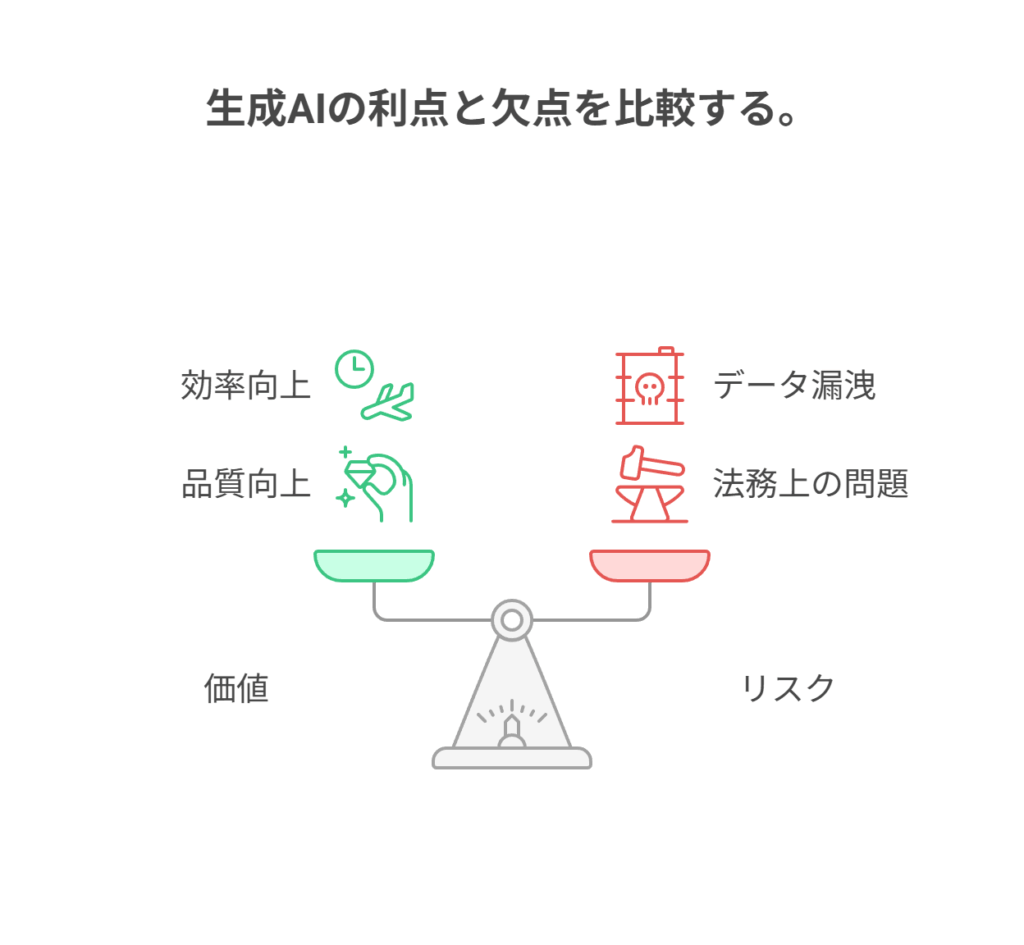

その主な目的は、以下の2つの両立にあります。

- リスクの最小化: 情報漏洩、法令違反、コンプライアンス違反、ブランドイメージの毀損といった潜在的なリスクを管理・予防する。

- 価値の最大化: AIを安全かつ効果的に活用することで、業務効率化、生産性向上、イノベーション創出を促進する。

重要なのは、ポリシーが単なる「禁止リスト」ではないという点です。むしろ、従業員が安心してAIの能力を活用するための「安全な使い方を示したガイドブック」と捉えるべきです。攻め(価値最大化)と守り(リスク最小化)のバランスを取ることが、ポリシー策定の核心と言えるでしょう。

生成AIがもたらす「価値」と「リスク」の二面性

社内AIポリシーの必要性を理解するためには、生成AIが持つ光と影、つまり価値とリスクの両面を正確に把握することが不可欠です。

期待できる価値(光の側面)

- 業務効率の飛躍的向上: 資料の要約、メール文面の作成、議事録の整理、アイデアの壁打ちなど、定型的なタスクにかかる時間を大幅に削減できます。

- 創造性の支援: ブレインストーミングの相手、キャッチコピーの提案、デザインの初期案作成など、クリエイティブな業務の質とスピードを高めます。

- 専門業務の補助: プログラミングのコード生成やレビュー、複雑なデータ分析、専門分野のリサーチなどをサポートし、専門家の業務を加速させます。

ある海外の研究では、専門職がAIの支援を受けてタスクに取り組んだ結果、タスク完了速度が平均で12.2%向上し、成果物の品質も向上したと報告されています。これらの価値を組織的に享受することが、これからの競争優位性を左右します。

潜在的なリスク(影の側面)

- 情報漏洩リスク: 従業員が機密情報(顧客情報、開発中の製品情報、人事情報など)をAIに入力し、それがサービス提供者のサーバーに保存されたり、AIの学習データとして利用されたりする危険性。

- 法務・コンプライアンスリスク:

- 著作権侵害: AIが学習データに含まれる他者の著作物を無断で複製・改変したコンテンツを生成してしまう。

- 個人情報保護法違反: 個人情報を不適切に入力・利用してしまう。

- 契約違反: 顧客や取引先との秘密保持契約(NDA)に違反する情報を入力してしまう。

- 品質・信頼性リスク:

- ハルシネーション(幻覚): AIが事実に基づかない、もっともらしい嘘の情報を生成する。

- 情報の偏り(バイアス): 学習データに含まれる偏見を助長・再生産するような不適切なコンテンツを生成する。

- 情報の陳腐化: 古い情報や誤った情報に基づいた回答を生成する。

ポリシーがないと起こる3つの典型的な問題

もし、明確なポリシーがないまま、従業員が個人の判断でAIを使い始めたら、組織はどのような問題に直面するのでしょうか。

- シャドーITの蔓延とリスクの不可視化:

会社が許可していないツール(シャドーIT)を従業員が勝手に使い始め、管理部門がリスクを全く把握できなくなります。どの部署で、誰が、どんな情報を、どのAIに入力しているのかが不明な状態は、情報セキュリティの観点から極めて危険です。 - 現場の萎縮と機会損失:

リスクを恐れるあまり、本来なら安全に使える場面でも従業員がAIの利用をためらってしまいます。結果として、他社がAIで生産性を向上させる中、自社だけがその恩恵を受けられないという機会損失につながります。 - インシデント発生時の対応の混乱:

万が一、情報漏洩や著作権侵害などの問題が発生した際に、判断基準となるルールがないため、対応が後手に回ります。責任の所在が曖昧になり、組織的な混乱を招き、被害が拡大する恐れがあります。

これらの問題を未然に防ぎ、組織全体として統制の取れたAI活用を進めるために、社内AIポリシーの策定が不可欠なのです。

社内AIポリシー策定の全体像:最短90日で実装する8ステップ

では、具体的にどのようにポリシーを策定していけばよいのでしょうか。ここでは、手戻りを防ぎ、実効性のあるポリシーを構築するための標準的な8つのステップをご紹介します。このプロセスに従えば、およそ90日(3ヶ月)で基本的な基盤を構築することが可能です。

- 【ステップ1】目的と適用範囲を定義する: なぜこのポリシーを作るのか、誰を対象とするのかを明確にします。

- 【ステップ2】プロジェクト体制をつくる: 誰が責任を持ち、誰が策定し、誰に相談するのか、役割分担を決めます。

- 【ステップ3】リスク評価(ユースケース単位): どのような業務でAIが使われそうか、それぞれのリスクは何かを洗い出します。

- 【ステップ4】ドラフト作成(必須7項目を骨子に): 後述する必須項目を盛り込んだポリシーの初版を作成します。

- 【ステップ5】業界別・部門別のカスタマイズ: 自社の事業内容や既存ルールに合わせて内容を調整します。

- 【ステップ6】パイロット運用と教育: 特定の部署で試験的に導入し、課題を洗い出すとともに、教育コンテンツを準備します。

- 【ステップ7】全社展開と周知: 完成したポリシーと関連資料を全社に公開し、説明会などを実施します。

- 【ステップ8】定期見直しと継続教育: 運用状況や技術の進展に合わせてポリシーを更新し続ける仕組みを作ります。

次のセクションから、各ステップの具体的な進め方を詳しく見ていきましょう。

【実践編】8ステップで進める社内AIポリシー策定の実務

ここでは、前述の8ステップについて、具体的なアクションと成果物を交えながら解説します。

ステップ1:目的と適用範囲を定義する

すべての土台となる最も重要なステップです。ここが曖昧だと、後続の議論が迷走してしまいます。

- 目的の言語化:

「情報資産を保護し、法令を遵守すると同時に、生成AIの安全な活用を通じて業務効率化とイノベーションを促進する」といったように、守りと攻めの両面を簡潔な言葉で定義します。これがポリシー全体の「憲法」となります。 - 適用範囲の明確化:

- 対象者: 正社員だけでなく、契約社員、派遣社員、業務委託先の担当者など、どこまでを対象とするかを明記します。

- 対象ツール: テキスト生成AI(ChatGPTなど)、画像生成AI、コード生成AIなど、対象とするAIツールの種類を定義します。

- 成果物: 「目的・適用宣言書」(1ページ程度)。プロジェクト関係者全員が常に立ち返るべき基本文書です。

ステップ2:関係者を巻き込むプロジェクト体制をつくる

AIポリシーは情報システム部門だけで作れるものではありません。多様な視点を取り入れるために、部門横断型のチームを編成しましょう。役割分担には「RACIチャート」(誰が実行責任者か、説明責任者か、協業相手か、報告先か)の考え方が役立ちます。

- 主な役割:

- 責任者 (Accountable): 経営層や情報セキュリティ責任者(CISOなど)が最終的な意思決定を行います。

- 起草・推進担当 (Responsible): 情報システム、情報セキュリティ、法務、コンプライアンス、人事、広報などの部門から担当者を集めた横断チーム。

- 現場代表 (Consulted): 実際にAIを使うことになる営業、開発、マーケティング、管理部門などから実務者を選出します。現場の視点を入れることで、実用性の高いポリシーになります。

- 相談窓口 (Informed): ポリシー運用後の問い合わせ対応やFAQ更新を担う担当者を決めます。

- 成果物: 体制表、役割分担表、意思決定フロー、連絡先リスト。

ステップ3:ユースケース別にリスクを洗い出す

抽象的にリスクを考えるのではなく、「具体的な業務シーン(ユースケース)」を想定してリスクを評価することが重要です。

- ユースケースの洗い出し:

- 例:社内向けプレゼン資料の構成案作成、公開済みプレスリリースの要約、顧客への定型メール文案の作成、プログラミングにおけるコードスニペットの生成など。

- リスク評価の観点:

- 入力するデータに機密情報や個人情報は含まれるか?

- データは社外のサーバーに送信されるか?

- 生成された出力は誰が見るのか?(社内のみ/社外公開)

- 出力の誤りが業務に与える影響は大きいか?

- 法令や第三者の権利(著作権など)に関わるか?

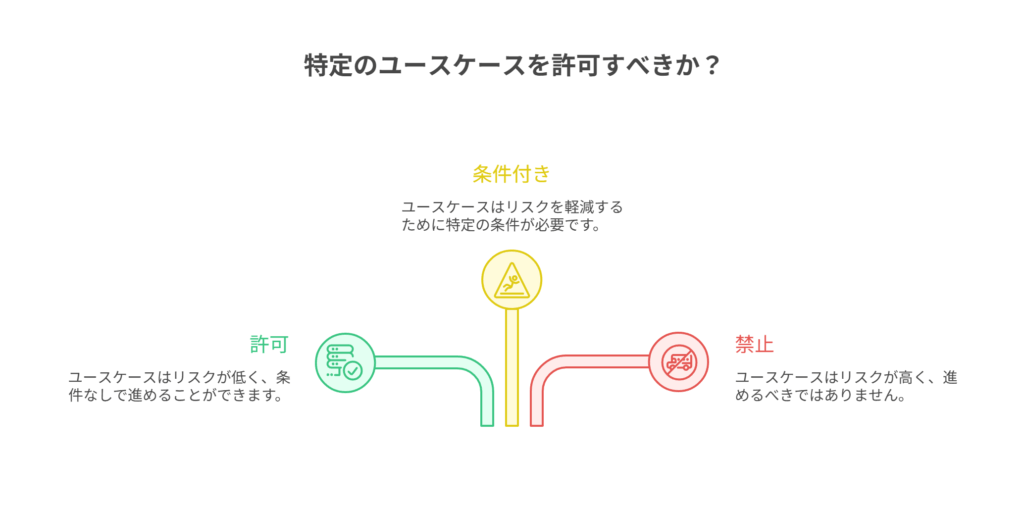

- 成果物: ユースケース別リスクマトリクス。各ユースケースを「許可」「条件付き許可」「原則禁止」などに分類し、その理由を明記した一覧表です。

ステップ4:ドラフト作成(必須7項目で骨子を)

リスク評価の結果を踏まえ、いよいよポリシーの草案を作成します。ここでは、後述する「必須7項目」を骨子として構成を組み立てるのが効率的です。この段階では完璧を目指さず、まずはたたき台を作ることを優先します。

ステップ5:業界・部門別に内容をカスタマイズする

ドラフトをベースに、自社の事業内容や文化に合わせて内容を具体化していきます。

- 業界特有の情報の明記:

- 金融: 顧客の口座番号、取引履歴

- 製造: 未公開の設計図面、部品表(BOM)、製造プロセス

- 医療: 患者のカルテ情報、治験データ

- メディア: 取材源に関する情報、未公開の記事

- 既存規程との整合性確保:

- 既に存在する「情報セキュリティ基本方針」「個人情報保護規程」「就業規則」などと矛盾がないかを確認し、必要に応じて参照関係を明記します。

- 公的雛形の活用:

- 総務省やJDLA(日本ディープラーニング協会)が公開しているガイドラインや雛形は、条文の構成や言い回しの参考になります。丸写しするのではなく、自社用に Anpassung (アジャスト) する視点で活用しましょう。

ステップ6:小規模なパイロット運用と教育で試す

いきなり全社展開するのではなく、まずは一部の部門で試験的に導入し、実用性や課題点を検証します。

- パイロット運用の実施:

- 協力的ないくつかの部門を選定し、一定期間(例:1ヶ月)ドラフト版ポリシーに基づいてAIを利用してもらいます。

- 利用ログやヒアリングを通じて、「ルールが分かりにくい」「このケースはどう判断すればいいか」といった現場の声を収集します。

- 教育コンテンツの準備:

- 全社展開に向けて、ポリシーの内容を分かりやすく伝えるための研修資料を準備します。eラーニング、短い解説動画、良いプロンプト例と悪いプロンプト例(NG集)など、多様な形式を用意すると効果的です。

ステップ7:全社展開と効果的な周知を行う

パイロット運用のフィードバックを反映してポリシーを最終化し、いよいよ全社に展開します。

- 情報の一元化:

- 社内ポータルや情報共有ツールに特設ページを設け、「ポリシー本文」「承認済みツール一覧」「よくある質問(FAQ)」「各種申請フォーム」などをまとめて掲載します。

- ポジティブなメッセージング:

- 「禁止」を強調するのではなく、「安全にAIを活用して、業務を効率化するための手引き」としてポジティブに周知します。推奨されるユースケースを具体的に示すと、従業員の利用意欲を高めることができます。

ステップ8:定期的な見直しと継続教育の仕組みを組む

AI技術と関連法規は日進月歩です。ポリシーを一度作って終わりにせず、継続的に更新していく仕組みをあらかじめ作っておくことが極めて重要です。

- 見直しサイクルの設定:

- 最低でも半年に一度、または技術的な大きな変化やインシデント発生時に、ポリシーを見直す定例会を設定します。

- フィードバックチャネルの確保:

- 現場からの改善提案や疑問点を常に受け付ける窓口を維持し、それらを次回の改訂に活かします。

- 継続的な教育:

- 新入社員向けの研修に組み込むほか、ポリシーが更新された際には、変更点を周知するためのミニ研修や通知を実施します。

【条文例付き】ポリシーに必ず含めるべき必須7項目

ここでは、どのような業種・業態の企業であっても、AIポリシーに盛り込むべき中核的な7つの項目について、その目的と具体的な条文例を解説します。

1. 入力禁止情報の定義

- 目的: 従業員による機密情報や個人情報の安易な入力を防ぎ、情報漏洩リスクを根本から断つこと。

- 条文例:

> 第X条(入力禁止情報)

> 以下の各号に定める情報は、会社が書面により明示的に許可した場合を除き、外部のサーバーで処理されるAIツールに入力してはならない。

> 1. 個人情報保護法に定める個人情報および要配慮個人情報

> 2. 当社の営業秘密(未公開の製品情報、技術情報、設計図面、ソースコード、顧客リスト、価格戦略、事業計画、財務情報、人事評価情報等)

> 3. 顧客、取引先、その他第三者との契約により秘密保持義務を負う情報

> 4. その他、会社が別途機密情報として指定した情報

2. 利用可能ツールの指定(バージョン・設定含む)

- 目的: 安全性が確認されていないツールの利用(シャドーIT)を防ぎ、会社として情報セキュリティを管理できる状態を維持すること。

- 条文例:

> 第X条(利用可能なAIツール)

> 1. 業務におけるAIツールの利用は、情報システム部がセキュリティ評価を行い承認したツール(以下「承認ツール」という)および会社が指定した設定・バージョンに限るものとする。

> 2. 承認ツールの一覧および利用上の注意点は、別途社内ポータルに掲示する。

> 3. 承認ツール以外のAIツールを業務で利用しようとする場合は、事前に所定の手続きに従い申請し、情報システム部の許可を得なければならない。

3. 出力の確認責任(ヒューマン・イン・ザ・ループ)

- 目的: AIの出力に含まれうる誤情報(ハルシネーション)、バイアス、権利侵害などを人間が介在してチェックし、AIの弱点を補うこと。「人間がループの中にいる(Human-in-the-Loop)」という考え方を徹底します。

- 条文例:

> 第X条(出力内容の確認責任)

> 1. AIによる生成物は、あくまで業務を補助するための参考情報として位置づける。

> 2. AIの生成物を、報告書、提案書、公開コンテンツ等の成果物として利用する場合、利用者は自己の責任において、以下の点を確認しなければならない。

> (1) 事実関係の正確性(ファクトチェック)

> (2) 第三者の著作権、商標権、その他の権利を侵害していないか

> (3) 差別的、誹謗中傷、その他不適切な表現を含んでいないか

> (4) 意図せず機密情報や個人情報が含まれていないか

> 3. 特に重要な意思決定や社外への公開を伴う成果物については、所属長または会社が指定するレビュー担当者の承認を得なければならない。

4. 記録・ログの保持

- 目的: AIの利用状況を記録することで、透明性を確保し、万が一問題が発生した際の原因究明や監査に備えること。

- 条文例:

> 第X条(利用記録の保持)

> 重要な意思決定の過程や、成果物の根拠としてAIを利用した場合、利用者は、利用年月日、目的、使用したAIツール、入力した主要な指示(プロンプト)、及び得られた主要な出力を、所定の方法で記録し、一定期間保管するものとする。ただし、記録にあたり個人情報や機密情報は適切にマスキングまたは匿名化すること。

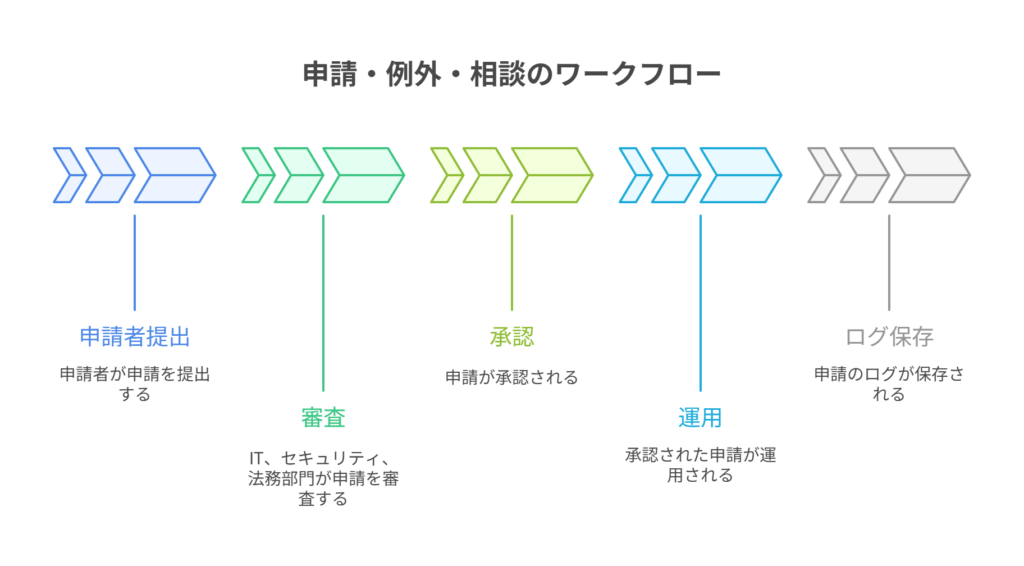

5. 例外・申請・相談のフロー

- 目的: 厳格なルールでイノベーションの芽を摘んでしまわないよう、例外的な利用を認めるための正式な手続きと、気軽に相談できる窓口を設けること。

- 条文例:

> 第X条(例外措置および相談)

> 1. 本ポリシーで禁止されている事項について、業務上やむを得ない理由により例外的な対応を希望する場合は、所定の申請書式を用いて申請し、情報セキュリティ委員会および法務部門の事前審査と承認を得なければならない。

> 2. 本ポリシーの解釈やAIツールの利用に関する判断に迷った場合は、速やかに社内ポータルに定める相談窓口に問い合わせること。

6. 違反時の取扱い

- 目的: ポリシー違反が重大な結果を招く可能性があることを示し、ルール遵守の意識を高めること。

- 条文例:

> 第X条(違反時の措置)

> 従業員が本ポリシーに違反したことが判明した場合、就業規則の定めに従い、懲戒処分を含む必要な措置を講じることがある。ただし、その判断にあたっては、故意または重大な過失の有無、会社に与えた損害の程度等を総合的に勘案する。

7. 教育と定期見直し

- 目的: ポリシーを形骸化させず、常に最新の状況に対応した実効性のあるものとして維持し続けることを宣言すること。

- 条文例:

> 第X条(教育および見直し)

> 1. 会社は、全従業員に対し、本ポリシーおよびAIの安全な利用に関する教育・研修を定期的に実施する。従業員は、会社が指定する教育プログラムを受講する義務を負う。

> 2. 会社は、AI技術の進展、関連法令の改正、事業環境の変化等を踏まえ、本ポリシーを定期的に見直すものとする。ポリシーが改訂された場合は、速やかに全社に周知する。

【コピペ可】今すぐ使える社内AIポリシー雛形(テンプレート)

以下に、これまでの解説を基にした汎用的な社内AIポリシーの雛形を用意しました。貴社の既存規程や事業内容に合わせて、[ ]内の箇所を修正・追記してご活用ください。

(ここからテンプレート)

生成AIの業務利用に関する社内ポリシー

版数・日付: v1.0 (発効日:YYYY年MM月DD日)

適用範囲: 全役職員(正社員、契約社員、嘱託社員、パートタイマー、アルバイト、派遣社員を含む)および当社の業務に従事する業務委託先の担当者

第1条 (目的)

本ポリシーは、当社における生成AIを含むAIツール(以下「AIツール」という)の業務利用に関する基本方針と遵守事項を定めるものである。これにより、情報資産と顧客・従業員の権利を保護し、関連法令・契約を遵守しつつ、AIツールを安全かつ効果的に活用し、業務効率化とイノベーションを推進することを目的とする。

第2条 (定義)

本ポリシーにおいて「AIツール」とは、利用者の指示(プロンプト)に基づき、テキスト、画像、音声、コード等のコンテンツを生成、要約、翻訳、分析等を行う、外部サービスまたは社内システムとして提供される一切のソフトウェア・アプリケーションを指す。

第3条 (利用の基本原則)

AIツールを業務で利用する者は、以下の基本原則を遵守しなければならない。

- 人間による最終確認: AIの生成物は参考情報であり、最終的な成果物としての正確性、適切性、品質については、利用者が責任を持つものとする。

- 承認済みツールの利用: 業務利用は、情報システム部が承認したツールおよび設定に限定する。

- 機密情報の非入力: 入力する情報の内容を事前に確認し、次条に定める入力禁止情報を扱わない。

第4条 (入力禁止情報)

会社が明示的に許可した場合を除き、以下の情報を外部のAIツールに入力してはならない。

- 顧客および従業員の個人情報

- 当社の営業秘密(未公開の製品情報、技術情報、設計図、ソースコード、価格戦略、財務情報、人事情報等)

- 第三者との契約により秘密保持義務を負う情報

- その他、会社が機密と指定する情報

第5条 (生成物の取扱い)

AIの生成物を社外へ提供または公開する前には、利用者の責任において、事実関係、権利関係(著作権等)、差別・偏見等の不適切な表現の有無、および機密情報の意図せぬ混入がないかを確認しなければならない。特に重要な文書については、所属長の承認を得るものとする。

第6条 (利用記録)

重要な意思決定の過程でAIツールを用いた場合、利用者は、目的、使用ツール、主要なプロンプト、及び得られた主要な出力を、所定の方法で記録・保管するものとする。

第7条 (例外申請)

承認リスト外のツールの業務利用や、入力禁止情報の匿名化処理を施した上での利用など、本ポリシーの例外的な取扱いを希望する場合は、所定の手続きに従って申請し、情報システム部および関連部門の審査と承認を得なければならない。

第8条 (相談窓口)

本ポリシーの解釈やAIツールの利用に関する不明点がある場合は、[担当部署名:例 情報システム部]に相談すること。よくある質問(FAQ)は社内ポータルに掲載する。

第9条 (教育)

従業員は、会社が指定する本ポリシーおよびAI利用に関する教育・研修プログラムを必ず受講しなければならない。

第10条 (違反時の措置)

本ポリシーへの違反が確認された場合、就業規則等の定めに従い、厳正な措置を講じる。

第11条 (見直し)

本ポリシーは、技術動向や法令改正等を踏まえ、定期的に見直しを行う。改訂した場合は、全社に速やかに周知する。

付則

本ポリシーは、YYYY年MM月DD日より施行する。

[付属文書として整備を推奨するもの]

- 付録A: 承認済みAIツール一覧(ツール名/用途/推奨設定/注意事項)

- 付録B: ユースケース別の利用可否・条件一覧

- 付録C: 各種申請フォーム(新規ツール利用申請/例外措置申請)

(テンプレートここまで)

ポリシー運用を支える関連ドキュメントとツール選定

ポリシー本文を策定するだけでは不十分です。実務で運用していくためには、具体的な手続きを定める関連ドキュメントの整備と、利用するツールの適切な選定が欠かせません。

併せて整備したい運用ドキュメント3選

- AI利用申請フォーム:

従業員が新しいツールを使いたい時や、例外的な使い方をしたい時に提出する書類です。これにより、リスク評価を体系的に行うことができます。- 主な項目: 申請者情報、利用目的、想定する入力データ(機密性、個人情報の有無、匿名化の方法)、期待される効果、利用期間、費用、関係部門(情報システム、法務など)の確認欄

- プロンプト・利用記録テンプレート:

重要な業務でAIを使った際の記録を残すための書式です。これにより、判断の経緯を後から追跡できるようになります。- 主な項目: 日付、案件名、目的、使用ツール、プロンプト(機密情報はマスキング)、主要な出力内容と採否の理由、最終的な成果物へのリンク、確認者サイン

- 利用可能ツール一覧:

従業員が「どのツールなら使っていいのか」を一目で確認できるリストです。- 主な項目: ツール名、許可バージョン、利用可否(○△×)、主な用途、禁止される使い方、特記事項(入力データが学習に使われるか、データの保存場所など)

安全なAIツールを選定するための5つの判断軸

社内で利用を許可するツールを選定する際には、以下の観点を総合的に評価しましょう。

- データ取扱いポリシー: 入力したデータがAIの学習に利用されるか、オプトアウト(学習への利用を拒否)する設定が可能か。データの保存期間や削除ポリシーは明確か。

- 提供形態とセキュリティ: クラウド経由のSaaSか、自社環境に構築できるオンプレミス型か。法人向けプランで、アクセス管理やIPアドレス制限などのセキュリティ機能が充実しているか。

- 監査・管理機能: 管理者が従業員の利用状況(プロンプト履歴など)を確認できる監査ログ機能があるか。

- 生成物の権利関係: AIが生成したコンテンツの著作権や商用利用権がどのように扱われるか、利用規約で明確に定められているか。

- 運用性: シングルサインオン(SSO)など既存のID管理システムと連携できるか。コストは妥当か。日本語のサポート体制は整っているか。

運用を成功に導くための5つの秘訣

素晴らしいポリシー文書を作成しても、それが現場で使われなければ意味がありません。ここでは、策定したポリシーを形骸化させず、組織に根付かせるための実践的な秘訣を5つご紹介します。

秘訣1:禁止ではなく「安全な使い方」を示す

最も多い失敗が、禁止事項ばかりを並べた「ダメ出し」のポリシーにしてしまうことです。これでは現場は萎縮し、シャドーITに走るだけです。「どうすれば安全に使えるのか」という視点で、推奨されるユースケースや、良いプロンプトの書き方などを積極的に提示しましょう。

秘訣2:現場を巻き込み「自分ごと化」を促す

策定段階から、実際にAIツールを使うことになる各部門の代表者に参加してもらいましょう。現場の意見を反映することで、実態に即した使いやすいルールになります。また、自分たちが策定に関わったルールであれば、遵守しようという意識(当事者意識)も自然と高まります。

秘訣3:成功事例とプロンプトを共有する文化をつくる

一人の従業員が見つけた便利な使い方や、効果的なプロンプトを、組織全体の資産として共有する仕組みを作りましょう。社内チャットやポータルに「AI活用事例共有チャンネル」のような場を設け、優れた投稿を表彰するなどの工夫も有効です。「Aさんのプロンプトを参考にしたら、資料作成時間が半分になった」といった成功体験が、ポジティブな利用を促進します。

秘訣4:相談しやすい窓口と迅速な対応体制を維持する

「このケースはグレーゾーンだけど、誰に聞けばいいかわからない…」という状況は、ルール違反の温床になります。相談窓口を明確にし、寄せられた質問には迅速かつ丁寧に回答する体制を整えましょう。よくある質問はFAQとして蓄積・公開することで、窓口の負担を減らしつつ、従業員の自己解決を促せます。

秘訣5:効果測定とフィードバックループを回す

ポリシー運用の効果を定期的に測定し、改善に繋げましょう。

- 定量的指標: AIツールの利用申請件数、インシデント発生件数、特定の業務にかかる時間の変化など。

- 定性的指標: 従業員へのアンケート調査、ヒアリングによる満足度や課題の把握など。

これらのフィードバックを分析し、ポリシーや教育内容の改善に活かすことで、運用サイクルが回り始めます。

FAQ(よくある質問)

Q1:生成AIが作った文章や画像の著作権はどうなりますか?

A: 非常に複雑な問題ですが、現状の日本の著作権法では、AI自体は著作者とは認められていません。生成物が既存の著作物に酷似している場合は、権利侵害と判断される可能性があります。そのため、社外で利用するコンテンツは、必ず人間が独創性を加えるとともに、類似の著作物がないかを確認するプロセスが不可欠です。

Q2:無料のAIツールを業務で使っても問題ないですか?

A: 原則として避けるべきです。無料ツールは、入力データがAIの学習に利用されたり、法人利用を規約で禁止していたりするケースが多く、セキュリティやコンプライアンス上のリスクが高いためです。必ず会社が承認した法人向けプランなどを利用してください。

Q3:AIの回答が間違っていた場合、誰の責任になりますか?

A: AIはあくまで道具であり、最終的なアウトプットに対する責任は、それを利用した人間にあります。ポリシーで「出力内容の確認責任は利用者にある」と明記し、ファクトチェックや複数人でのレビューを徹底することが重要です。

Q4:入力データがAIの学習に使われるのを防ぐ方法はありますか?

A: 多くの法人向けAIサービスでは、管理設定画面で「入力データをAIの学習に利用しない(オプトアウト)」という選択が可能です。ツールを選定する際や導入時に、この設定が可能か、そしてデフォルトで有効になっているかを必ず確認してください。

Q5:どの業務からAI活用を始めるのがおすすめですか?

A: まずは、機密情報の入力が不要で、かつ定型的な業務から始めるのが安全で効果を実感しやすいでしょう。例えば、「公開情報の要約」「社内文書のたたき台作成」「ブレインストーミングのアイデア出し」などです。小さな成功体験を積み重ね、徐々に応用範囲を広げていくのが定石です。

Q6:禁止事項ばかりだと、現場から反発されませんか?

A: その懸念はもっともです。だからこそ、ポリシー策定のメッセージとして「禁止」ではなく「安全な活用方法の提示」を前面に出すことが重要です。推奨ユースケースや便利なプロンプト例を豊富に提供し、「使うことで得られるメリット」を具体的に示すことで、現場の理解と協力を得やすくなります。

結論:AIポリシーは未来への投資

社内AIポリシーは、単なるリスク管理のための規則ではありません。それは、生成AIという革命的なテクノロジーを、組織の力として安全に取り込み、持続的な成長を実現するための「未来への投資」です。

明確な目的設定、現場を巻き込んだ策定プロセス、そして継続的な改善の仕組み。これらを組み合わせることで、ポリシーは「守りの盾」であると同時に、生産性向上を加速させる「攻めのエンジン」となり得ます。

海外の研究が示す生産性向上のポテンシャルは、すべての企業に開かれています。確かなガバナンスという土台の上に、AI活用の文化を築き、競争の激しい時代を勝ち抜くための新たな武器を手に入れましょう。

今すぐできる、はじめの一歩

この記事を読んで、「やらなければ」と感じていただけたなら、まずは以下の3つのアクションから始めてみてください。

- 1ページの「目的・適用範囲」宣言書を書いてみる: なぜ自社にAIポリシーが必要なのか、誰のためのものなのかを、あなたの言葉でまとめてみましょう。

- 関係部署に声をかける: 情報システム、法務、人事などのキーパーソンに、「AIポリシーについて一緒に考えたい」と30分のミーティングを打診してみましょう。

- 現場のヒアリング: 実際にAIを使っていそうな部署のメンバーに、「どんなことにAIを使っているか、何に困っているか」を気軽に聞いてみましょう。

この小さな一歩が、あなたの会社をより強く、よりスマートな組織へと変革する大きな推進力となるはずです。

AIポリシー策定の壁、「きれいごと」の裏側で本当に起きていたこと 先日公開した「社内AIポリシー策定ガイド」の記事、おかげさまで多くの方に読んでいただけたようです。あの記事は、いわば「理想の航海図」。ステップ通りに進めば、安全な港に[…]